Il 26 marzo 2026, il Chief Digital & AI Office (CDAO) del Dipartimento della Difesa degli Stati Uniti (Pentagono) ha stanziato 600 milioni di dollari a favore di Anthropic, Google e xAI per lo sviluppo di pipeline di intelligenza artificiale (IA) agentiva, a seguito di un finanziamento di 200 milioni di dollari assegnato a OpenAI a febbraio. Questo maggiore investimento mira a rafforzare l'utilizzo di modelli linguistici su larga scala (LLM) in risposta alle crescenti pressioni operative e alla rilevanza strategica dell'argomento, riconosciuta dal Segretario alla Guerra Pete Hegseth.

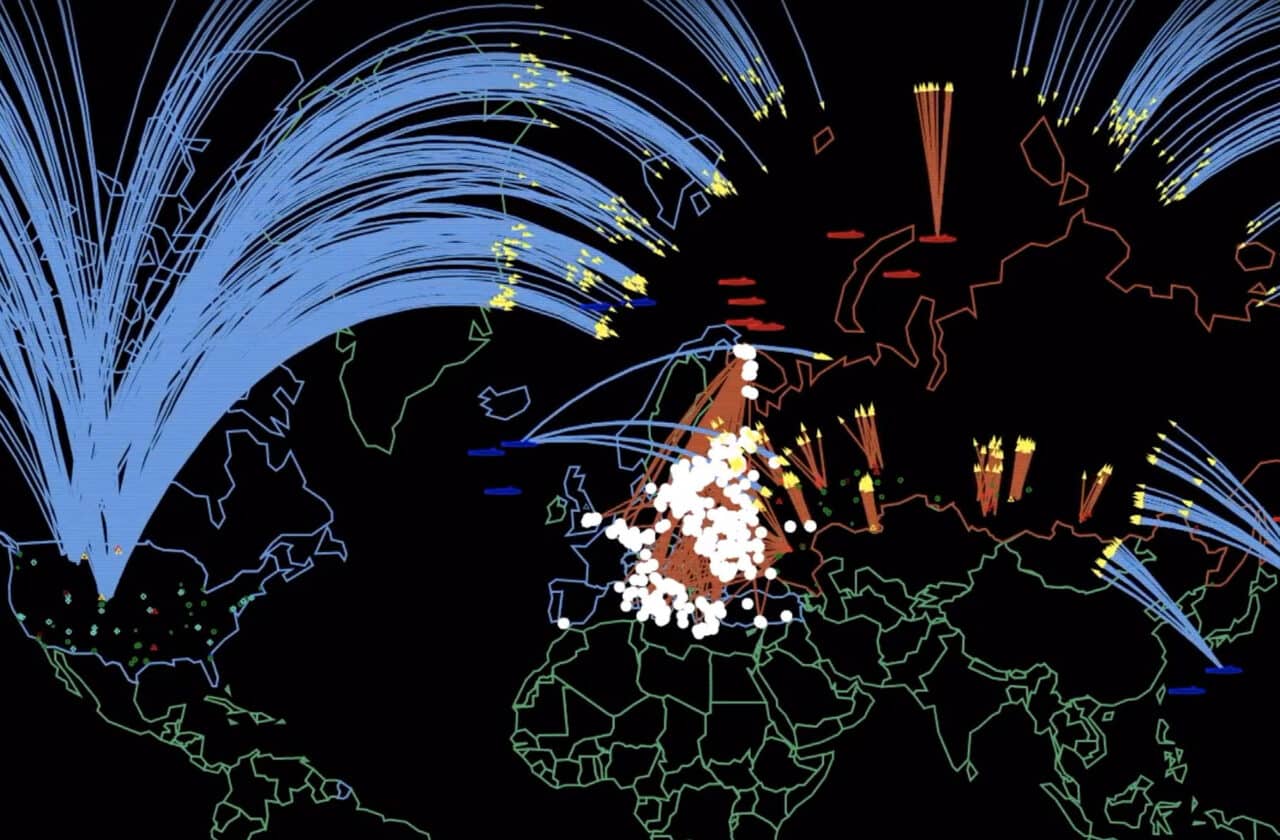

Tuttavia, recenti simulazioni hanno dimostrato i pericoli derivanti dall'utilizzo dei LLM nei processi decisionali o di programmazione militare, mentre Anthropic, l'editore del Claude LLM, si rifiuta di rimuovere alcune misure di sicurezza e vieta l'uso del suo strumento per la sorveglianza di massa e gli attacchi letali automatizzati. E tutto ciò non è affatto gradito al Pentagono…

Il Pentagono sta accelerando l'adozione di LLM come Claude e ChatGPT a tutti i livelli del processo decisionale militare.

Negli ultimi mesi, il Pentagono ha accelerato l'implementazione di strumenti basati su modelli linguistici estesi (LLM), comunemente noti come tali, spinto dalla crescente pressione durante i periodi di conflitto. Ricordiamo che un LLM è un modello conversazionale in grado di supportare una conversazione prolungata con un essere umano, in cui è difficile determinare se l'interlocutore sia digitale o umano. In questo senso, gli LLM, come il noto ChatGPT, sono tra i primi strumenti ad aver superato teoricamente il test di Turing.

Nelle forze armate, le pratiche quotidiane di gestione dei sistemi basati sull'intelligenza artificiale sono cambiate rapidamente, senza che vi fossero prove concrete di un monitoraggio degli effetti dell'IA sugli utenti, nonostante la moltiplicazione dei casi d'uso, sia in numero che in portata. Questa dinamica, priva di un'osservazione sistematica, ha creato punti ciechi, sia a livello umano che organizzativo, riguardo all'influenza di questi strumenti sul giudizio operativo. Di conseguenza, gli effetti negativi sul processo decisionale possono rimanere irrisolti senza l'adozione di opportune misure correttive.

Studi recenti indicano che l'uso diffuso di modelli di apprendimento automatico (LLM) omogeneizza il pensiero, erode la riflessione critica e favorisce la dipendenza cognitiva, indebolendo la capacità di discernimento in ambienti complessi. Il viceammiraglio Pierre Vandier, numero due della NATO, ha recentemente avvertito che l'espansione dell'intelligenza artificiale ci espone a presentazioni fuorvianti che dobbiamo essere in grado di riconoscere. Sotto intensa pressione operativa, la standardizzazione cognitiva può quindi ridurre la capacità delle unità di mantenere un pensiero indipendente.

Diversi attori del settore hanno espresso riserve concrete, in particolare Anthropic, lo sviluppatore del Claude LLM, che ha implementato misure di sicurezza tecniche e contrattuali contro la sorveglianza di massa, alcune applicazioni offensive e armi autonome operanti senza supervisione umana. Le aziende sollevano anche preoccupazioni circa l'utilizzo dei loro strumenti da parte di personale non addestrato alla valutazione dei risultati, il che aumenta il rischio di interpretazioni errate in situazioni di stress. Questi segnali convergenti mettono in discussione la capacità dei modelli conversazionali generici di supportare la pianificazione militare senza una supervisione rigorosa.

Le tensioni si acuirono alla fine di febbraio 2026, quando il Segretario alla Difesa Pete Hegseth chiese ad Anthropic di revocare tutte le restrizioni del Pentagono sull'utilizzo dei prodotti dell'azienda. Il Defense Production Act fu menzionato come potenziale strumento per obbligare le aziende private a contribuire allo sforzo bellico.

In caso di rifiuto, il ministro ha minacciato di classificare Anthropic come azienda a rischio di approvvigionamento, imponendo severe restrizioni contrattuali e rescindendo l'accordo da 200 milioni di dollari tra la società e il potere esecutivo, il che avrebbe indubbiamente portato a problematiche prospettive di borsa per l'editore di software. È certamente su quest'ultimo punto che il Dipartimento della Difesa intende concentrare i propri sforzi per costringere Anthropic, e soprattutto il suo CEO, a conformarsi, più per ottenere un quadro giuridico completamente chiaro e senza vincoli che per poter utilizzare specificamente Claude (molto efficace, a dire il vero) nella propria pianificazione.

L'Ufficio del Pentagono per il Digitale e l'IA stanzia 600 milioni di dollari per flussi di lavoro di intelligenza artificiale agentiva implementabili.

A tal proposito, il 26 marzo 2026 il Chief Digital & AI Office ha annunciato lo stanziamento di 600 milioni di dollari in contratti tra Anthropic, Google e xAI, con un tetto massimo di 200 milioni di dollari per ciascun contratto. L'adozione sta quindi entrando in una fase industriale strutturata, con un ritmo di implementazione sostenuto e una competizione incentrata sulla fornitura rapida di prestazioni per gli usi previsti.

Questo articolo è ora riservato agli abbonati.

Articoli in questa sezione Notizie sulla Difesa sono completamente accessibili durante 72 ore dopo la loro pubblicazione. Successivamente, entrano a far parte del feed riservato agli abbonati di MetaDefense.

L'abbonamento può essere annullato in qualsiasi momento, a partire da 1,99 €.