Le 26 mars 2026, le Chief Digital & AI Office (CDAO) du département de la Défense des États-Unis (Pentagone) a engagé 600 M$ auprès d’Anthropic, Google et xAI pour des flux d’intelligence artificielle (IA) agentique, après que aient été 200 M$ attribués à OpenAI en février. Cette montée en puissance doit permettre de renforcer l’usage des modèles de langage de grande taille (LLM), alors que la pression opérationnelle s’accroît et que le sujet est identifié comme stratégique par le Secrétaire à la guerre, Pete Hegseth.

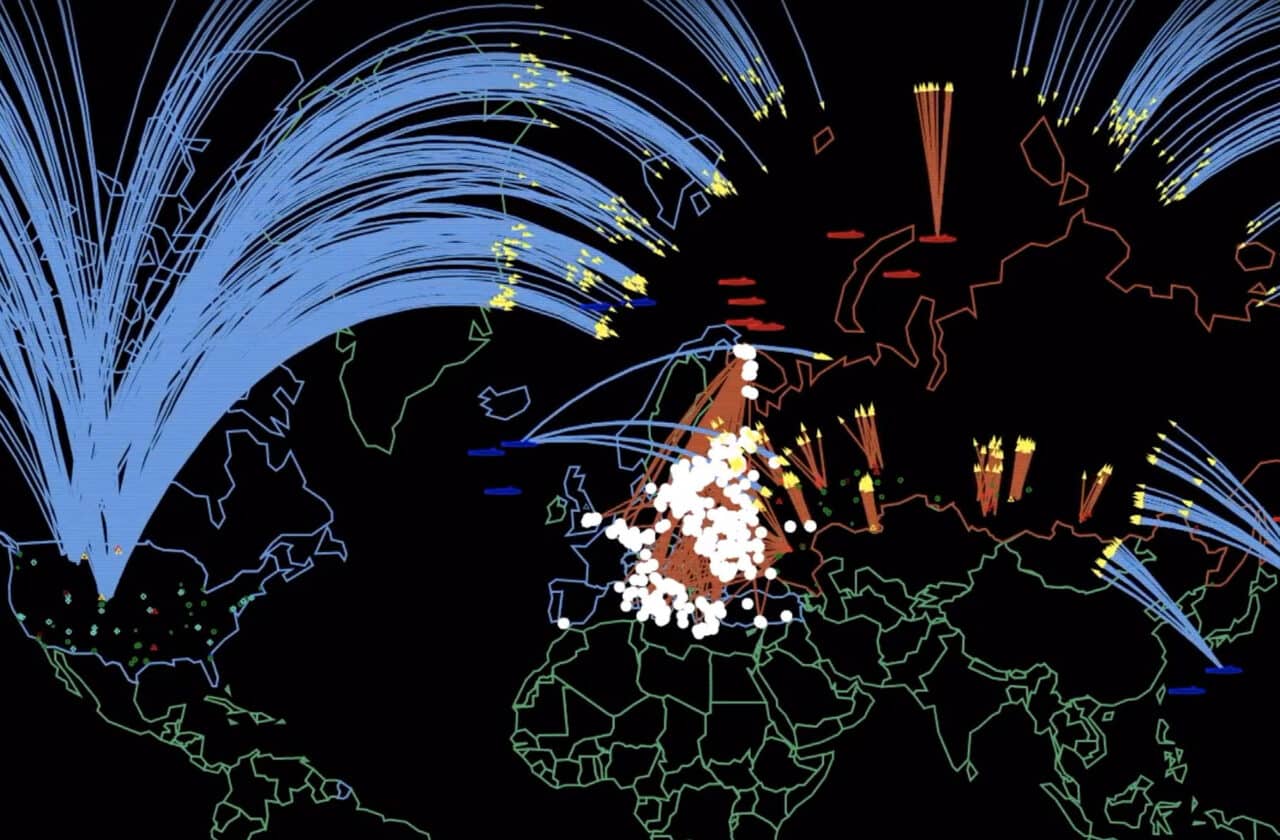

Toutefois, des simulations ont récemment montré les dangers liés à l’utilisation des llm dans la décision ou la programmation militaire, alors que Anthropic, l’éditeur du llm Claude, refuse de retirer certains garde-fous et interdit l’utilisation de son outil pour la surveillance de masse et l’attaque létale automatisée. Et toute ceci n’est pas du tout du gout du Pentagone …

Le Pentagone accélère l’adoption des LLM comme Claude et ChatGPT à tous les niveaux de la décision militaire

Le Pentagone a accéléré, ces derniers mois, le déploiement d’outils fondés sur des modèles de langage étendu, ou LLM pour l’acronyme communément employés, sous l’effet d’une pression d’usage accrue en période de conflit. Pour rappel, un LLM désigne un modèle conversationnel capable de soutenir une conversation étendue avec un humain, sans qu’il soit aisé de déterminer si l’interlocuteur est numérique ou humain. En ce sens, les LLM comme le célèbre ChatGPT, sont les premiers outils a répondre dans l’esprit, au test de Turing.

Les pratiques quotidiennes des llm ont changé rapidement dans les armées, sans preuves solides d’un suivi des effets de l’IA sur les utilisateurs, alors même que les cas d’usage se multipliaient, en nombre comme en périmètre d’application. Cette dynamique, sans observation systématique, a créé des angles morts tant humains et qu’organisationnels sur l’influence de ces outils sur le jugement opérationnel. Elle peut donc laisser passer des effets négatifs sur la décision sans correctifs adaptés.

Des travaux récents signalent ainsi que l’usage généralisé des LLM homogénéise la pensée, érode la réflexion critique et installe une dépendance cognitive, fragilisant le discernement en environnement complexe. Le vice-amiral Pierre Vandier, n°2 opérationnel de l’OTAN, a prévenu, il y a peu, que l’extension de l’IA exposait à des présentations trompeuses qu’il faut savoir reconnaître. Sous forte pression d’emploi, la standardisation cognitive peut ainsi réduire la capacité des unités à préserver une réflexion indépendante.

Plusieurs acteurs industriels ont exprimé des réserves concrètes, notamment Anthropic, concepteur du LLM Claude, qui a instauré des garde-fous techniques et contractuels contre la surveillance de masse, certaines applications offensives et des armes autonomes sans supervision humaine. Des entreprises alertent aussi sur l’usage de leurs outils par des personnels non formés à l’évaluation des sorties, ce qui accroît les risques d’interprétation en situation de stress. Ces signaux convergents mettent en cause l’aptitude de modèles conversationnels génériques à soutenir la planification militaire sans encadrement strict.

Les tensions se sont cristallisées fin février 2026, lorsque le secrétaire à la Défense Pete Hegseth a exigé d’Anthropic la levée de toutes les restrictions d’emploi par le Pentagone. Le Defense Production Act a été évoqué comme levier potentiel pour contraindre des entreprises privées à soutenir l’effort de défense.

En cas de refus, le ministre a menacé de classer Anthropic comme risque pour les approvisionnements, avec des restrictions contractuelles lourdes et la fin de l’accord de 200 M$ liant l’entreprise à l’exécutif, entrainant des perspectives boursières certainement problématiques pour l’éditeur. Nul doute que c’est précisément sur ce dernier point que le DoD entend appuyer pour faire plier Anthropic et surtout son CEO, plus pour obtenir un paysage juridique entièrement dégagé et sans contrainte, que pour pouvoir spécifiquement utiliser Claude (très efficace au demeurant) dans sa planification.

Le Chief Digital & AI Office du Pentagone engage 600 M$ pour des flux d’IA agentique prêts à déployer

Justement, à ce sujet, le Chief Digital & AI Office a annoncé le 26 mars 2026 la répartition de 600 M$ de contrats entre Anthropic, Google et xAI, chaque attribution comportant un plafond de 200 M$. L’adoption entre ainsi dans une phase industrielle structurée, avec un rythme de déploiement soutenu et une concurrence centrée sur des performances livrables rapidement pour des usages cibles.

Cet article est désormais réservé aux abonnés

Les articles de la rubrique Actualités Défense sont accessibles en intégralité pendant 72 heures après leur publication. Au-delà, ils rejoignent le flux réservé aux abonnés MetaDefense.

Abonnement résiliable à tout moment, à partir de 1,99 €.